美國時間 3 月 16 日,輝達(NVDA)年度 GTC 大會在聖荷西 SAP 中心正式揭幕。執行長黃仁勳發表了近三小時的主題演講,面對超過三萬名現場觀眾,一口氣發布了新一代運算平台、AI 代理軟體堆疊、太空資料中心計畫,以及和迪士尼合作的實體 AI 機器人。

對投資人而言,這場演講的核心訊號非常明確:輝達正式宣告「推理時代」來臨,並將 2025 至 2027 年的晶片營收展望從原先的 5,000 億美元翻倍上調至 1 兆美元。這個數字不只是輝達一家公司的故事,更是整個 AI 產業鏈未來兩年的資本支出風向球。

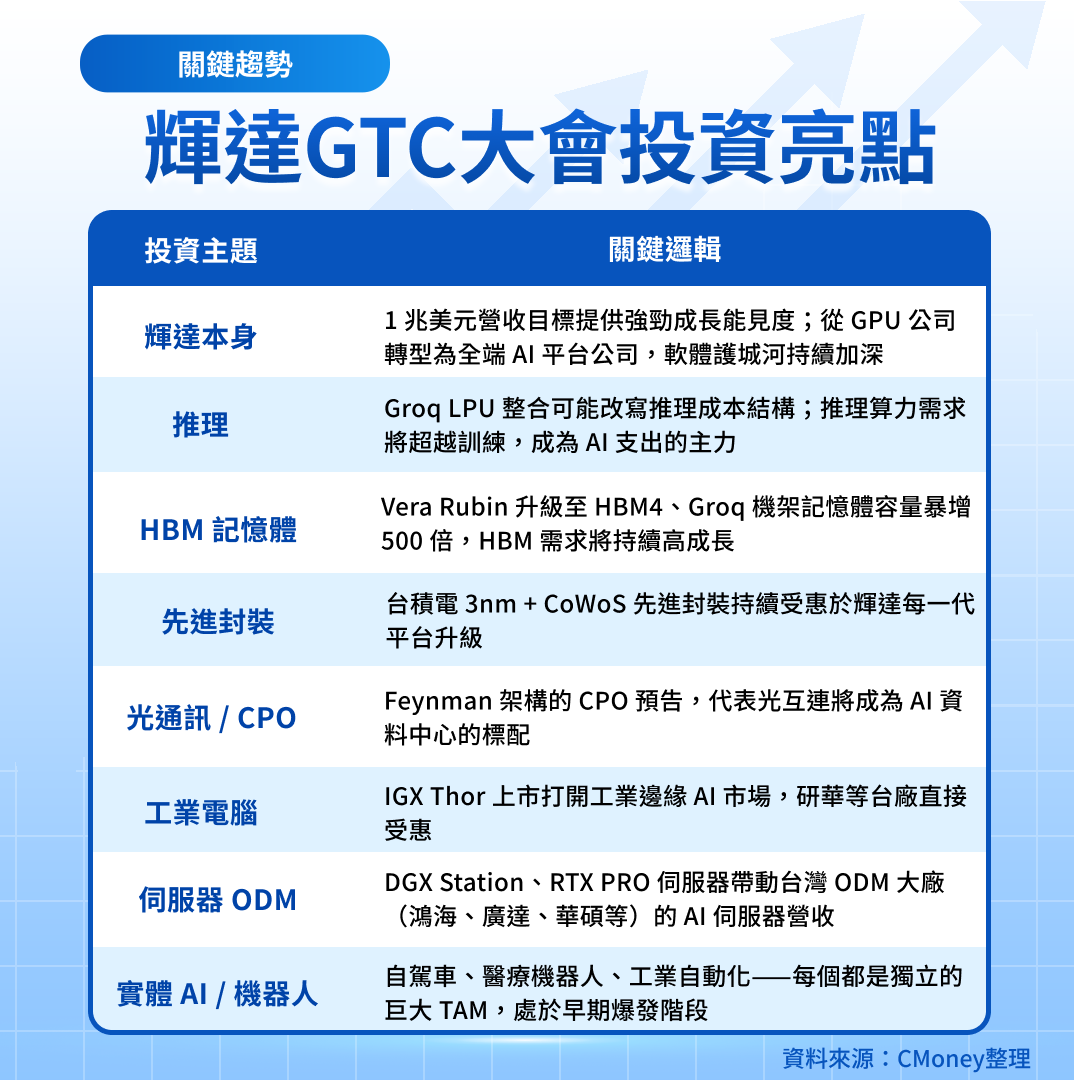

以下,我們將從硬體、軟體、雲端合作、邊緣部署、實體 AI 與供應鏈六個維度,帶投資人完整拆解這場演講的關鍵資訊與潛在投資機會。

一、1 兆美元營收展望,數字背後的三層意義

黃仁勳在演講中正式將 Blackwell 與 Vera Rubin 平台的累計營收預估,從去年 GTC 提出的 5,000 億美元(至 2026 年)大幅上調至 1 兆美元(至 2027 年底) 。這是輝達史上最激進的財務預測,背後有三層值得投資人拆解的意義:

1. 訂單能見度極強

這個數字並非空中畫餅。全球超大規模雲端服務商——包括亞馬遜(AMZN)、微軟(MSFT)、谷歌(GOOGL)、臉書(META)與甲骨文(ORCL)——對 AI 基礎設施的需求依然處於供不應求的狀態 。亞馬遜(AMZN)旗下 AWS 在本次大會上宣布將部署超過 100 萬顆輝達GPU ,微軟(MSFT)Azure 則成為首家啟用新一代 Vera Rubin NVL72 系統的超大規模雲服務商 。這些大單提供了營收預測的底氣。

2. 全球資料中心正在大換血

黃仁勳指出,全球現有資料中心的已安裝基數價值約 1 兆美元,而這些設施正從「傳統通用運算」加速轉型為「加速運算與生成式 AI」架構 。他預測未來四到五年,全球資料中心基礎設施總價值將倍增至 2 兆美元 。輝達作為加速運算的核心供應商,將直接分食這塊「基礎建設蛋糕」 。

3. 推理取代訓練成為成長引擎

過去兩年,市場對輝達的敘事主要圍繞「訓練」——大型語言模型需要海量 GPU 來完成初始訓練 。但黃仁勳明確表示,推理(Inference)已取代訓練成為運算需求成長最快的領域 。隨著 Agentic AI(代理 AI)與實體 AI 的普及,企業需要持續、大量的推理算力來運行即時智慧服務,這才是驅動 1 兆美元支出的核心動力 。

投資人關鍵訊號:1 兆美元不只是營收目標,更是 AI 資本支出週期持續擴張的最強背書。若目標達成,輝達將成為史上首家靠銷售 AI 硬體達成 1 兆美元累計營收的公司 。

二、硬體核彈,Vera Rubin 平台與推理專用架構

本次大會的硬體發布密度極高 。輝達不再只是賣 GPU,而是發布了一整套「全端運算平台」,涵蓋晶片、伺服器、機架系統與網路架構 。

Vera Rubin:下一代全端 AI 平台

Vera Rubin 是輝達全新的旗艦平台,以發現暗物質的天文學家維拉·魯賓命名 。它包含七款晶片、五個機架級系統,以及一台專為智能體 AI 設計的超級電腦 。平台採用全新的 Vera CPU——效率是傳統 CPU 的兩倍、速度快 50% ——搭配 BlueField-4 STX 儲存架構,實現從運算到網路的垂直整合 。

Groq 3 LPU:推理專用處理器正式整合

去年 12 月,輝達以 200 億美元的技術授權協議收購了 Groq 的高層領導團隊 。本次大會上,Groq 3 LPU(語言處理單元)正式整合進輝達的產品線 。全新的 Vera Rubin + Groq 3 LPX 機架,將 72 台 Vera Rubin 伺服器與 256 個 LPU 結合 ,每秒可產生 7 億個 token,運算速度比上一代 Hopper 架構快 350 倍 ,高頻寬記憶體容量更是 Hopper 世代的 500 倍 。

黃仁勳在台上直言:「推理轉折點已經到來。這就是致勝秘訣。」 他自稱輝達的代幣(token)成本是全球最低的 ,並欣然接受了分析師給予的「推理之王」封號 。

Feynman:再下一代架構預告

除了 Vera Rubin,黃仁勳還預告了更下一代的 Feynman 架構 。該平台將搭載全新 CPU「Rosa」(以發現 DNA 結構的羅莎琳德·富蘭克林命名) ,結合 LP40 低功耗處理器、BlueField-5、CX10 網路元件,並透過 Kyber 連接技術實現銅纜與共封裝光學(CPO)的縱向擴展 。這代表輝達的產品路線圖至少延伸到 2028 至 2029 年。

太空資料中心:Space-1 Vera Rubin

最令人意外的發布是輝達宣布進軍太空 。名為「Space-1 Vera Rubin」的計畫,目標是將 AI 資料中心送入軌道,把加速運算從地球擴展到太空 。黃仁勳坦言最大挑戰是散熱——太空中沒有傳導和對流,只能依靠輻射散熱 。雖然這更像是長期願景而非短期營收來源,但它清楚傳達了輝達對運算規模無限擴張的野心。

投資人關鍵訊號: Vera Rubin + Groq LPU 的組合,代表輝達從「GPU 公司」徹底轉型為「全端 AI 基礎設施公司」 。推理專用硬體的整合,意味著未來營收結構將從一次性訓練訂單,轉向持續性的推理運算服務收入 。

三、軟體護城河,OpenClaw 生態與 NemoClaw 平台

如果硬體是輝達的「矛」,那軟體生態就是它的「盾」。本次大會上,輝達(NVDA)在軟體層面的布局力度絲毫不亞於硬體。

OpenClaw:被比喻為「如同 HTML 和 Linux 一樣重要」

黃仁勳重點介紹了 OpenClaw——一個開源的智能體電腦作業系統專案 。開發者只需一條命令即可下載 OpenClaw,啟動 AI 代理,並使用各種工具進行擴充 。黃仁勳將其重要性提升到了前所未有的高度,直言「OpenClaw 的意義不容小覷。它和 HTML 一樣重要,和 Linux 一樣重要」 ,並強調「如今世界上每一家公司都必須制定 OpenClaw 策略」 。

值得注意的是,OpenAI 在 OpenClaw 走紅後迅速將其收購,而臉書(META)則收購了其社群媒體衍生產品 Moltbook ,顯示科技巨頭對代理 AI(Agentic AI)生態的爭奪已進入白熱化。

NemoClaw:企業級安全代理堆疊

為了確保 OpenClaw 能在企業內部安全部署,輝達推出了 NemoClaw 技術堆疊 。它結合了策略執行、網路防護和隱私路由功能,內建 OpenShell 沙箱環境,讓企業可以在受控條件下運行自主 AI 代理 。黃仁勳表示,NemoClaw 可以作為「全球所有 SaaS 公司的策略引擎」 。

Nemotron 聯盟:六大前沿模型系列

輝達(NVDA)同步宣布成立 Nemotron 聯盟,圍繞六個前沿模型系列聚集合作夥伴:Nemotron(語言和推理)、Cosmos(世界和視覺)、Isaac GR00T(通用機器人)、Alpamayo(自動駕駛)以及 BioNeMo(生物和化學氣候) 。此外,輝達(NVDA)還宣布成立一個由 Cursor、Mistral、Perplexity、Reflection 和 Thinking Machines 等軟體公司組建的開放模型聯盟,旨在簡化前緣開源人工智慧模型的開發流程 。

投資人關鍵訊號: 輝達的軟體生態布局正在複製「CUDA 飛輪」的成功模式 。當開發者被深深鎖定在輝達的軟體堆疊中,硬體的轉換成本將大幅提高——這才是輝達最深的護城河。OpenClaw 生態若成為 Agent AI 的事實標準,將加速全球軟體即服務(SaaS)產業向智慧人工智慧即服務(Agentic AI-as-a-Service)轉型 。

四、雲端巨頭全面加碼,AWS 與 Microsoft 的深度綁定

雲端服務商是輝達最大的客戶群體,本次大會上的合作公告,進一步確認了 AI 資本支出週期的持續性。

微軟 Azure:Vera Rubin NVL72 首發

微軟(MSFT)在不到一年內,已在全球資料中心大規模部署了數十萬塊液冷輝達Grace Blackwell GPU。微軟Azure 更是首個啟用全新 Vera Rubin NVL72 系統的超大規模雲端服務供應商,該系統將在未來幾個月內在全球推出。此外,開發人員現可直接在 Microsoft Foundry 中使用輝達Nemotron 開放模型建置和部署專用代理程式。微軟安全部門也致力於開發 NemoClaw,以提高代理程式的安全性、可靠性和效率 。

亞馬遜旗下 AWS:超過 100 萬顆 GPU + Groq LPU

亞馬遜(AMZN)旗下 AWS 宣布擴大與輝達的合作,部署包括 LPU 和超過 100 萬顆輝達GPU 在內的 AI 基礎架構。擴展後的基礎設施將涵蓋完整的輝達AI 計算堆疊,包括 Blackwell 和 Rubin GPU 架構、RTX PRO Blackwell 伺服器版 GPU,以及 Groq 3 LPU。亞馬遜旗下 AWS 也成為首家宣布支援 RTX PRO 4500 雲端執行個體的雲端服務商。同時,輝達Nemotron Nano 3 已作為 Amazon Bedrock 上的可選模型推出,為Salesforces(CRM)的 Agentforce 提供支持。

投資人關鍵訊號: 亞馬遜旗下 AWS 和微軟Azure 的部署規模,直接驗證了輝達1 兆美元營收展望的可信度。輝達Nemotron 模型進入 Amazon Bedrock 和 Microsoft Foundry,代表輝達不只賣硬體,更在積極搶佔模型層與軟體生態的價值。

五、邊緣 AI 與工作站,算力下沉到工廠與桌面

輝達的野心不僅止於服務雲端巨頭,目前正積極將 AI 算力推向邊緣設備與企業桌面。在桌面級超級電腦方面,全新發布的 DGX Station 由 GB300 Grace Blackwell Ultra 桌上型超級晶片驅動,提供高達 20 PFLOPS 的 AI 運算效能,足以運行規模達 1 兆個參數的開放模型。目前包含Snowflake(SNOW)、微軟(MSFT)研究院與康乃爾大學等機構已率先採用;而台灣代工供應鏈如華碩(2357)、技嘉(2376)、微星(2377),以及國際大廠戴爾(DELL)、美超微(SMCI)等 OEM 廠,也將在未來幾個月內開始出貨。此外,針對企業團隊設計的 DGX Spark 則支援多台系統叢集,能輕易在辦公室內組成「桌面資料中心」,目前已成功協助金融機構加速風險建模、醫療團隊縮短研發時間,並讓能源公司優化營運,顯示多個傳統行業已正式從評估階段進入實際部署。

在工業邊緣運算部分,專為實體 AI 打造的 IGX Thor 平台正式宣佈上市,其具備即時感知、企業級可靠性與功能安全性。該平台一上市便獲得大量重量級客戶導入,例如重機械巨頭卡特彼勒(CAT)將其應用於駕駛室 AI 助手、醫療大廠嬌生(JNJ)用於數位手術平台,而日立(Hitachi)、Planet Labs(PL)與歐洲核子研究組織(CERN)也分別將其應用於軌道預測性維護、太空衛星資料處理與高階物理模型運算。同時,針對企業級伺服器推出的 RTX PRO 4500 Blackwell Server Edition,以輕巧的單槽設計讓視覺 AI 效能比純 CPU 方案大幅提升 100 倍。目前包含 NTT DATA、太平洋生物科學(PACB)與諾基亞(NOK)均已計畫採用,而阿卡邁(AKAM)與亞馬遜旗下 AWS 更將成為首批提供相關雲端實例的服務商。

投資人關鍵訊號: AI 算力正全面從雲端向邊緣與桌面擴散,這為輝達打開了龐大且全新的可定址市場。從 DGX Station 到 IGX Thor 橫跨各領域的豪華客戶名單可以看出,AI 的滲透率正加速跨越純科技業,深入金融、醫療、工業製造與航太等傳統產業,這不僅是營收的增量來源,更是支撐整個 AI 產業鏈長線估值擴張的最強底氣。

六、實體 AI,從螢幕走向真實世界

如果說過去兩年的 AI 革命主要發生在螢幕上(例如語言模型與圖像生成),那麼 GTC 2026 釋出最明確的訊號就是:AI 正在全面走向真實的物理世界。在自動駕駛領域,輝達的自駕計程車平台一口氣新增了比亞迪、現代汽車、日產汽車與吉利汽車等四大跨國車廠作為合作夥伴,並宣布與叫車平台優步(UBER)合作,將自動駕駛車輛直接整合進其龐大的叫車網路中。此外,包含瑞士 ABB、優傲科技與庫卡等工業機器人領導品牌,也正積極整合輝達的實體 AI 模型與模擬工具,加速工業自動化的進程。

在醫療機器人方面,輝達發布了專為醫療領域打造的開放式實體 AI 模型,包含擁有 776 小時龐大手術影片的 Open-H 資料集、合成手術數據生成模型 Cosmos-H,以及視覺語言動作模型 GR00T-H。包含 CMR Surgical、嬌生醫療技術、PeritasAI 與 Proximie 皆成為首批採用者。這代表 AI 的應用邊界已大幅跨越,不再僅限於分析靜態的醫學影像,而是開始直接參與並輔助複雜的手術操作流程。而整場主題演講的最高潮,莫過於迪士尼(DIS)動畫《冰雪奇緣》中的雪人奧拉夫以實體機器人形態走上舞台,與黃仁勳進行生動互動。這個機器人由輝達的 Newton 物理引擎、Omniverse 模擬平台與 Jetson 晶片共同驅動,在 Omniverse 虛擬環境中學會走路後,便直接部署到實體機器人上。黃仁勳更藉此暗示了未來的商業願景:「迪士尼樂園的未來,將是到處都有機器人與卡通人物在遊蕩。」

投資人關鍵訊號: 實體 AI 無疑是輝達打開下一個十年成長曲線的最關鍵鑰匙。從自駕車、醫療機器人、工業自動化到娛樂機器人,每一個應用領域背後都是獨立且潛力龐大的巨大市場。在這個長線趨勢下,台灣廠商在機器人供應鏈中扮演的角色,例如和大(1536)與上銀(2049)等關鍵零組件廠的後續接單動態,絕對值得投資人密切追蹤與提前佈局。

台廠供應鏈誰先卡位?五大明確受惠主線

對台股投資人而言,每一次 GTC 大會都是觀察供應鏈受惠邏輯的最佳窗口。從本次大會透露的重要訊號來看,台廠供應鏈正積極在各個關鍵領域卡位。在先進製程與封裝方面,台積電(2330)不僅是 Vera Rubin 平台 3 奈米製程的核心代工夥伴,同時也是輝達(NVDA)新發布的 cuEST 量子化學加速庫的首批採用者,利用加速量子化學推進下一代矽設計製程。例如,新思科技(SNPS)便借助 cuEST 將半導體模擬速度提高了 30 倍,而三星(005930.KS)也獲得了 5 倍的端到端速度提升。

在記憶體與高頻寬記憶體(HBM)領域,Vera Rubin 平台全面升級至 HBM4 記憶體,且 Groq 3 LPX 機架的高頻寬記憶體容量更是上一代 Hopper 世代的 500 倍。這項硬體規格的躍升直接利好 HBM 供應商,包括 SK 海力士(000660.KS)和三星的記憶體部門。另一方面,算力下沉也帶動了工業電腦與邊緣系統的商機。包含研華(2395)、華擎(3515)、新漢(8234)與英業達(2356),以及康泰科技、安能科技和元科技等台廠,正積極打造工業級和醫療級的 IGX Thor 系統,這些公司將直接受惠於 AI 邊緣部署的加速趨勢。

在伺服器與整機櫃組裝方面,鴻海(2317)、廣達(2382)與緯創(3231)等台灣 ODM 大廠,在輝達(NVDA)AI 工廠與整機櫃方案中持續扮演著不可或缺的關鍵角色。此外,DGX Station 桌面級超級電腦的 OEM 合作夥伴也涵蓋了華碩(2357)、技嘉(2376)與微星(2377)等大廠,且 RTX PRO 4500 伺服器的組裝夥伴名單中同樣出現多家台廠的身影。最後,針對未來傳輸瓶頸,Feynman 架構預告的共封裝光學(CPO)技術,對光通訊族群無疑是一大重大利多。隨著 AI 資料中心規模持續擴張,光互連已成為解決能耗與傳輸瓶頸的唯一解方,相關供應鏈絕對值得投資人提前佈局。

從 GTC 看未來兩年的佈局方向

綜合 GTC 2026 Day 1 的所有資訊,以下是投資人可以帶走的幾個核心觀點:

GTC 2026 首日傳遞的訊息很明確,AI 資本支出週期不僅沒有放緩,反而正在加速擴張。輝達用 1 兆美元的營收展望、推理專用硬體、全端軟體生態和實體 AI 佈局,向市場證明了自己不只是「賣鏟子的人」,更是定義整個 AI 基礎設施遊戲規則的人。

對投資人來說,短期內最直接的觀察指標是各大雲端廠商的實際部署進度,以及台灣供應鏈廠商在下半年法說會中透露的 AI 相關營收佔比變化。中長期而言,推理經濟學的演進、OpenClaw 生態的成熟度、以及實體 AI 的商業化速度,將決定這波 AI 投資週期能走多遠。

GTC 的其他場次仍在進行中,CMoney 團隊將持續追蹤。

延伸閱讀:

版權聲明

本文章之版權屬撰文者與 CMoney 全曜財經,未經許可嚴禁轉載,否則不排除訴諸法律途徑。

免責宣言

本網站所提供資訊僅供參考,並無任何推介買賣之意,投資人應自行承擔交易風險。