高盛因合約與資安顧慮,停止香港員工使用Anthropic Claude,僅保留其他AI模型存取。

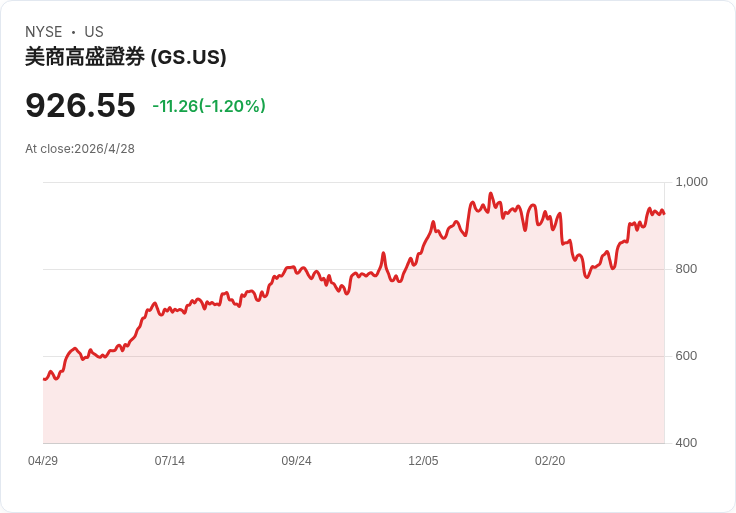

高盛(Goldman Sachs)近日已在香港內部平臺上撤銷員工對Anthropic旗下Claude模型的存取權,訊息由路透援引知情人士報導,並由金融時報率先披露。此舉在銀行與監管機構對生成式AI風險高度關注的背景下,引發市場與業界對資料安全、合約風控與跨境AI使用規範的關切。

背景與事實: - 事情緣由:據報導,高盛先前允許香港員工透過內部AI平臺使用Anthropic的Claude,但在近週內該存取權被關閉。金融時報指出,這是高盛在與Anthropic溝通並採取對合約條款較為嚴格的解讀後所做出的決定。Anthropic向媒體表示,其Claude系列從未在香港被官方「支援」。 - 其他AI工具仍可用:報導同時指出,高盛內部平臺仍可使用其他大型模型,例如Google的Gemini與OpenAI的ChatGPT(未受此次變更影響)。 - 監管與市場環境:Anthropic最新模型Mythos因可能對銀行系統構成風險,已受到全球銀行與監管機關關注。香港金融管理局(HKMA)也表示,部分銀行正評估因應先進AI引發之網路安全威脅的額外防護措施。另在2024年,OpenAI曾限制來自中國的API流量,以示大型模型供應與地域使用之限制性趨勢。

深度分析: 1) 風險動機:銀行業對客戶資料保護、合規與系統性風險特別敏感。生成式AI可能在未充分控制下外洩敏感資訊、被用作模型再訓練,或因不透明輸出導致合規與操守問題。高盛採取「嚴格合約解讀」反映出對上述風險的預防性管理。 2) 合同與供應商界定:Anthropic指出其在香港並非正式支援,這突顯出AI供應商、使用方與地域法律/支援宣告之間的模糊地帶。對銀行而言,沒有明確的市場支援或法律保障,意味著合約風險與合規成本上升。 3) 地緣政治因素:美中在高階運算、AI研發及資料治理上的摩擦,亦促使美國企業在中國大陸與特定區域採取更保守的產品與API供應策略,香港位處微妙地位,成為政策與商業決策的交叉點。 4) 矛盾觀點與駁斥:支持者認為此舉是必要防護,能避免潛在系統性風險;批評者則指此類封鎖可能降低員工效率、阻礙創新並造成不必要的業務負擔。駁斥觀點在於,對於處理高價值客戶資料與金融決策的機構,短期生產力損失通常可接受,因為一次重大資安或合規事件的代價遠超過即時便利。

案例與比較: - OpenAI在2024年限制來自中國的API流量,為此類地域性限制提供前例,顯示美國AI公司可能基於風險控管而限制某些市場流量。 - HKMA的評估說明監管層面已在加強對AI相關網安與運用的關注,若更多銀行採取類似措施,行業標準可能迅速收緊。

結論與展望/行動建議: 高盛此舉是金融機構在快速演變的AI環境下採取預防性風險管理的具體案例。短期內,市場可預見更多銀行與金融機構會審查其AI供應商合約、限制特定模型或在香港等敏感市場採取更嚴格的使用政策。對投資人與管理層而言,應關注三件事:一、金融機構AI政策與合規框架的透明化;二、AI供應商對各市場支援宣告與技術保證的明確性;三、監管導向是否會朝向統一標準或更嚴格的審查。呼籲銀行加速建立資料分類、模型審核與第三方供應商風險評估機制,並建議監管機構儘速發布具體指引,以平衡創新應用與系統性安全。

點擊下方連結,開啟「美股K線APP」,獲得更多美股即時資訊喔!

https://www.cmoney.tw/r/56/9hlg37